Un vídeo viral difundido en redes sociales ha vuelto a poner en el centro del debate la seguridad del sistema Full Self-Driving (FSD) de Tesla. Las imágenes muestran cómo un Tesla Model 3 circulando con este sistema activado atraviesa las barreras de un paso a nivel sin detectarlas, en un incidente ocurrido en West Covina, California, en el área metropolitana de Los Ángeles.

El suceso se produce además en un momento especialmente delicado para la compañía de Elon Musk, ya que coincide con el plazo marcado por las autoridades estadounidenses para que Tesla entregue datos clave relacionados con una investigación sobre posibles infracciones y fallos del sistema de conducción asistida.

El vídeo se ha hecho viral

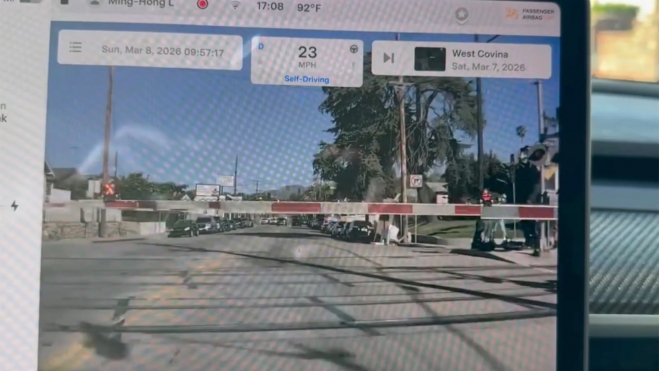

Las imágenes fueron publicadas el 8 de marzo en la red social Threads por el usuario Laushi Liu, propietario del vehículo. En el vídeo, grabado por la cámara del propio coche, se observa cómo el Tesla circula a unos 23 km/h mientras se aproxima a un paso a nivel.

Las barreras del cruce ferroviario ya se encontraban bajadas cuando el coche se aproximó, pero el sistema no mostró señales de detectarlas ni de intentar frenar. El vehículo continuó avanzando hasta impactar contra las barreras.

Según el propio conductor, que tituló la publicación con el mensaje “Tesla FSD casi me mata hoy”, intentó intervenir en el último momento. El vídeo sugiere que el conductor presionó el freno justo cuando se produjo el impacto.

La grabación ha generado miles de comentarios en redes sociales. Mientras algunos usuarios recuerdan que el sistema requiere supervisión constante del conductor, otros critican que Tesla utilice la denominación “Full Self-Driving” para un sistema que en realidad se clasifica como nivel 2 de conducción asistida, es decir, que no permite conducción autónoma completa.

Fallos en pasos a nivel ya detectados

Tesla FSD drives through railroad crossing gate

by u/nobod78 in TeslaFSD

Este no es el primer incidente relacionado con el sistema FSD en pasos ferroviarios. Investigaciones periodísticas y reportes de conductores han documentado más de 40 incidentes similares en redes sociales.

En uno de los casos más graves, un Tesla Model 3 fue golpeado por un tren en Pensilvania después de que el sistema condujera el vehículo hasta las vías. En aquel episodio, los ocupantes lograron salir del coche antes del impacto.

La reiteración de estos problemas llevó a varios senadores estadounidenses, entre ellos Ed Markey y Richard Blumenthal, a pedir una investigación formal sobre la capacidad del sistema para gestionar cruces ferroviarios.

Investigación federal sobre el sistema FSD

El incidente viral coincide con el plazo límite impuesto por la Administración Nacional de Seguridad del Tráfico en Carreteras de Estados Unidos (NHTSA) para que Tesla entregue información detallada sobre posibles infracciones relacionadas con el sistema FSD.

La investigación, iniciada en octubre de 2025, está analizando 58 incidentes vinculados al sistema, entre ellos 14 accidentes y 23 personas heridas. Posteriormente el número de casos documentados aumentó hasta 80 situaciones investigadas.

La agencia está examinando cerca de 2,88 millones de vehículos Tesla equipados con este sistema, incluyendo posibles fallos como saltarse semáforos en rojo, invadir carriles contrarios o problemas en pasos a nivel.

Tesla solicitó dos ampliaciones del plazo para entregar la documentación, alegando que debía revisar más de 8.300 registros, muchos de los cuales requieren análisis manual.

El organismo exige datos detallados de cada incidente, incluyendo qué versión del software estaba instalada, si el conductor recibió advertencias del sistema y si hubo daños personales o materiales.

Debate sobre la seguridad y el márketing

El nuevo incidente reabre el debate sobre los límites reales de los sistemas de conducción asistida actuales y sobre cómo se presentan al público.

Aunque Tesla insiste en que el conductor debe mantener siempre el control del vehículo, algunos expertos y legisladores cuestionan que el nombre “Full Self-Driving” pueda generar una percepción equivocada sobre las capacidades reales del sistema.

El resultado de la investigación de la NHTSA podría ser determinante para definir el futuro regulatorio de estas tecnologías en Estados Unidos y otras partes del mundo.